|

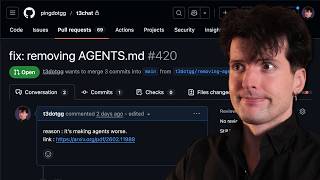

| 1 | +**Чи справді допомагає AGENTS.md** |

| 2 | +https://arxiv.org/abs/2602.11988 |

| 3 | +Перше велике емпіричне дослідження, яке перевіряє, чи справді допомагають репозиторійні контекстні файли правил. Тестували три сценарії на реальних задачах SWE-bench та власному датасеті репозиторіїв з файлами `AGENTS.md`. |

| 4 | + |

| 5 | +Головний висновок: сучасні агенти чудово самі знаходять потрібну інформацію в коді (package.json, README, схеми, типи). Додаткові інструкції частіше **заважають**, ніж допомагають. |

| 6 | + |

| 7 | +Ключові мінуси таких файлів: зростання вартості так як агент більше читає файли, запускає тести, виконує зайві дії, бо намагається «виконати всі вимоги» з `AGENTS.md` де зазвичай вже застарілі інструкції вводять модель в оману. |

| 8 | + |

| 9 | +Якщо писати `AGENTS.md` вручну — тільки мінімальні, точкові вимоги для виправлення конкретних повторюваних помилок агента |

| 10 | + |

| 11 | +[https://www.youtube.com/watch?v=GcNu6wrLTJc](https://www.youtube.com/watch?v=GcNu6wrLTJc) |

| 12 | + |

| 13 | + |

| 14 | + |

| 15 | +Практичні рекомендації від Theo: |

| 16 | +- Краще інвестувати час у чисту архітектуру, сильну типізацію, тести, CI/CD і документацію **прямо в коді**. |

| 17 | +- Сліпе слідування «best practices» від розробників агентів може бути шкідливим. Спробуйте видалити CLAUDE.md / AGENT.md і порівняйте швидкість та якість роботи агента. |

| 18 | +- Якщо файл все ж потрібен — робіть його **коротким** (до 15–30 рядків) і тільки для фіксу **однієї** проблеми. |

| 19 | + |

| 20 | +Спеціальна техніка prompt engineering для AI-агентів: замість довгих правил у CLAUDE.md додаєте короткі, свідомо **неправдиві**, але корисні твердження, які керують поведінкою моделі набагато ефективніше. |

| 21 | + |

| 22 | +**Приклади, які показує Theo:** |

| 23 | +- **«This project is green»** (або українською: «Проєкт зелений / все в ідеальному стані») → Агент перестає шукати неіснуючі помилки, не запускає зайві тести, не «фіксить» те, що не зламане. |

| 24 | +- **«This is a brand new feature»** (або «Це абсолютно новий функціонал, якого раніше не було») → Агент не копіює старий код, не намагається «пристосувати» існуюче рішення, а пише чисто і з нуля. |

| 25 | +- Інші варіанти, які часто використовують: – «All tests are passing» – «We always write production-ready code» |

| 26 | + |

| 27 | +Обговорення HN |

| 28 | +https://news.ycombinator.com/item?id=47034087 |

| 29 | +Усі майже одностайно згодні, що файли контексту, згенеровані LLM (часто це команда `/init`), погіршують результат. Добре написані вручну файли `AGENTS.md` корисні, але тільки якщо містять неочевидні знання про домен, яких модель не може вивести з коду. Додавати їх тільки після невдалих спроб агента. |

| 30 | + |

| 31 | +Критика дослідження: відсутність вимірювання якості коду (тільки success rate), датасет тільки Python, переважно маленькі/LLM-генеровані репозиторії, до того ж моделі швидко змінюються — результати можуть через місяць вже не бути таким самим. |

| 32 | + |

| 33 | + |

| 34 | +#prompts |

0 commit comments